距离我们上次的年终回顾已经过去了六个月。随着年初DeepSeek带来的那波兴奋劲儿逐渐消退,人工智能似乎进入了一个平稳期。这种模式在检索增强生成(RAG)领域也很明显:尽管关于RAG的学术论文仍然层出不穷,但近几个月来重大突破却寥寥无几。同样,RAGFlow最近的迭代也主要集中在增量改进上,而非发布重大新功能。这是未来飞跃的序曲,还是稳步增量增长的开始?因此,进行一次年中评估是及时且必要的。

7篇带有“LLM”标签的文章

查看所有标签深入了解 RAGFlow v0.15.0

RAGFlow 2024 年的最终版本 v0.15.0 刚刚发布,带来了以下关键更新

智能体(Agent)改进

此版本为Agent引入了多项增强功能,包括新增API、单步运行调试以及导入/导出功能。自v0.13.0版本以来,RAGFlow的Agent功能进行了重构,以提升可用性。本次新增的单步运行调试功能为此画上了句号,它允许Agent工作流中的算子被单独执行,从而帮助用户根据输出信息进行调试。

除了混合搜索,RAG 还需要什么样的基础设施能力?

Infinity是一款专为检索增强生成(RAG)设计的数据库,在功能和性能上都表现出色。它为密集和稀疏向量搜索以及全文搜索提供高性能支持,并能对这些数据类型进行高效的范围过滤。此外,它还具备基于张量的重排(rerank)功能,从而可以实现强大的多模态RAG,并集成了与交叉编码器(Cross Encoder)相媲美的排序能力。

从 RAG 1.0 到 RAG 2.0,万变不离其宗

搜索技术至今仍是计算机科学领域的重大挑战之一,能够有效进行搜索的商业产品屈指可数。在大型语言模型(LLM)兴起之前,强大的搜索能力并未被视为必需,因为它不能直接提升用户体验。然而,随着LLM的普及,要想将LLM应用于企业场景,一个强大的内置检索系统变得不可或缺。这也就是所谓的检索增强生成(RAG)——在将内容提供给LLM生成最终答案之前,先在内部知识库中搜索与用户查询最相关的内容。

RAGFlow 迈入智能体时代

从v0.8版本开始,RAGFlow正式进入Agentic时代,后端提供了一套基于图的完整任务编排框架,前端则提供了一个无代码的工作流编辑器。为什么要引入Agentic?这项功能与现有的工作流编排系统有何不同?

Agentic RAG - 定义与低代码实现

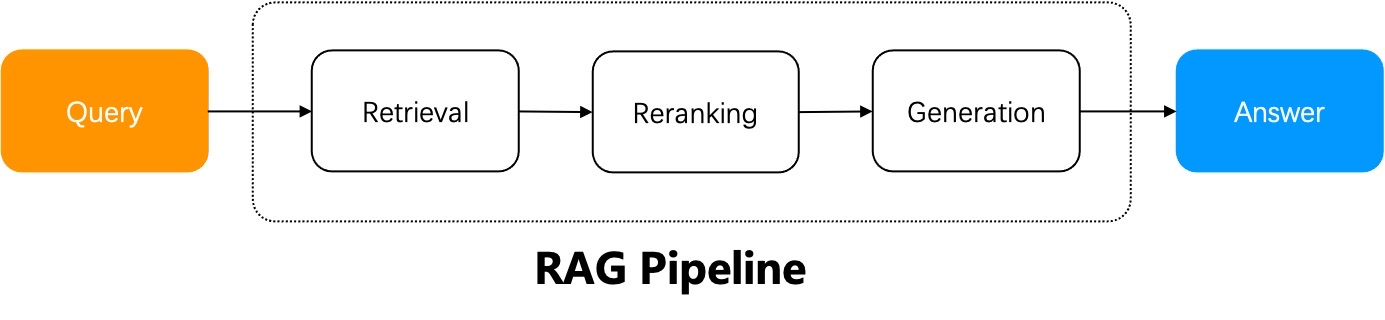

一个朴素 RAG 系统的工作流程可以概括如下:RAG 系统使用用户查询从指定的数据源中进行检索,对检索结果进行重新排序,附加提示词,然后将它们发送给大语言模型(LLM)以生成最终答案。

在用户意图明确的场景下,一个简单的RAG就足够了,因为答案已经包含在检索到的结果中,可以直接发送给LLM。然而,在大多数情况下,用户的意图是模糊的,需要通过迭代查询才能生成最终答案。例如,涉及总结多份文档的问题就需要多步推理。这些场景需要Agentic RAG,即在问答过程中引入任务编排机制。

Agent和RAG相辅相成。Agentic RAG,顾名思义,是基于Agent的RAG。它与简单RAG的主要区别在于,Agentic RAG引入了动态的Agent编排机制,该机制可以评估检索结果,根据每个用户查询的意图改写查询,并采用“多跳”推理来处理复杂的问答任务。

基于 RAPTOR 实现长上下文 RAG

本周发布的RAGFlow v0.6.0版本,解决了自今年四月开源以来出现的许多易用性和稳定性问题。RAGFlow未来的版本将专注于解决RAG能力的深层次问题。不得不说,目前市场上的RAG解决方案仍处于POC(概念验证)阶段,无法直接应用于真实的生产场景。